云云众生s

SLM 是一種更具成本效益的方法,它允許公司在安全的環境中將模型適應其專有資料。

譯自Use Small Language Models To Deploy AI on a Budget,作者 Emily Freeman。

AI 正在顛覆科技產業。關於通用人工智慧(AGI) 及其取代人類的能力的討論無所不在。無論未來是在十年後還是一年後,許多團隊都需要協助充分利用 AI。

只有少數公司維護我們所知的 LLM——GPT、Claude、Bard、LaMDA、LLaMA 等——因為訓練所需的資源極其昂貴。

LLM在海量資料集上進行訓練。這些模型只是開始。它們提供了一個令人難以置信的平台來建立更有效、更客製化的解決方案:在您的特定資料上訓練的小型語言模型 (SLM)。是什麼讓 SLM 變小?簡而言之——參數數量。

要理解 SLM 對現實世界應用的價值,您必須了解 LLM 的冗長性。 OpenAI 的 GPT-3 有 1750 億個參數,而 Meta 的 Llama 3.1 有一個包含 4050 億個參數的版本。但這意味著什麼? LLM 使用 Transformer 模型來標記和分析數據,利用參數來消費、解釋和產生人類語言。

如果您閱讀過任何資料,您可能會發現「標記」和「參數」可以互換使用,但它們是不同的。

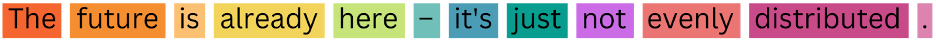

標記是 LLM 的離散資料單元。在下面的範例中,每個單字都被 LLM 作為標記攝取。

根據模型的不同,標記可以是字詞、片語、字元等。標記允許 LLM 將資料分解並有效地評估它。例如,LLM 可能將“cats”一詞解釋為與“cat”相同,以標準化資訊。

您可能在問自己,「更多的參數更好嗎?」好吧,就像科技中的所有事物一樣,這取決於情況。如果您需要在牆上掛一幅畫,Home Depot 中的每種工具都比錘子和釘子更好嗎? LLM 是令人難以置信的技術壯舉,它們計算大量資訊的能力越來越好,速度也越來越快。但是,訓練和微調 LLM 所需的成本和時間對於大多數公司來說是不可取的。它們太大了。

大多數企業不需要萬能工具,而需要一個針對特定任務的特定工具。這就是 SLM 閃耀的地方。

在您的數據上訓練模型雖然 LLM 必須使用大量的雲端資源進行訓練,但訓練 SLM 使用專有數據,並且計算效率高且成本效益高。假設您是一家政府承包商,負責回應招標書 (RFP) 以獲得合約。

通常,您將有一個團隊審查這些RFP,手動收集響應所需的相關信息,回答有關您的公司如何滿足合約需求的詳細問題,並編寫完整的提案,包括所需的工作角色以及這些工作的相應政府代碼。

RFP 從未公開發布,這意味著 LLM 無法在它們上進行訓練,而您的公司編寫的數百甚至數千份提案都是專有的。想像一下,如果您可以在所有專有資料上訓練一個 SLM,並讓 SLM 代表您產生詳細的提案。

您能想像您的團隊將節省多少時間嗎?您可以透過從基礎模型(如Llama 3.1)開始,並在先前的 RFP 和相應的提案上微調 SLM 來做到這一點。您也可以使用Arcee.AI等工具。無論哪種情況,為了充分利用您的 SLM,您需要完成四個關鍵步驟:1/ 持續預訓練,2/ 對齊,3/ 模型合併,4/ 檢索增強生成 (RAG) 以及 5/ 持續適應。

了解訓練 SLM 的步驟想像一下,我們的小型語言模型是 Dominique,一個高中二年級的學生。預訓練是 Dominique 在所有先前年份中學到的所有東西——數學、科學、語言藝術、體育、藝術——所有東西。模型合併是我將擅長數學的 Dominique 與擅長科學的 Asma 配對,讓他們在餘下的學年裡一起學習和測試。儘管他們在某個特定主題上特別出色,但他們將在兩個主題上都非常出色。

關於對齊和微調,指令調優(對齊的第一部分)可以被描述為 Dominique 在大二時所接受的課程。批評階段(對齊的第二部分)是對 Dominique 作業的回饋。 RAG 就像給 Dominique 一場開卷考試;她可以找到相關資訊來幫助她取得更好的成績。最後,持續適應會更新 Dominique 的知識,因為資訊會改變(例如,冥王星不再是行星),所以她擁有最新、最及時資訊。

實施您的模型在政府承包商的例子中,他們想要建立一個 SLM 來撰寫提案。開發人員將使用較小的開源模型,例如 Llama 的較小版本之一(70B 或 8B 參數),並使用其先前提案、先前 RFP 和任何其他相關文字資料的專有資料對其進行訓練。

然後可以使用開源工具將該模型合併 – 可能是專門用於語言或其他特定領域的更通用的模型。例如,如果他們有一個專門為軍隊創建提案(使用特定術語和詞彙)的模型,以及另一個專門為建造火箭撰寫提案的模型,則可以將它們合併以撰寫高度專業和準確的建造軍隊火箭的提案。請記住,只有當模型具有相同的架構和大小時,才能將它們合併。

從那裡,他們將希望對齊這個新合併的模型,以確保它提供所需的結果。這包括提供預期結果的範例,並與模型互動以測試它是否產生所需類型的內容。

雖然像Arcee.AI 這樣的工具可以在沒有RAG 的情況下獲得相同的結果,但如果您是從頭開始構建,則可以使用RAG 層來允許它準確地檢索特定信息並生成更準確的文本或進行實時資料檢索。例如,政府職位代碼將是保存在 RAG 層中的絕佳資料。

最後,就像人類一樣,SLM 始終在不斷發展和學習。部署後,模型可以隨著業務資料和需求的變化而更新。根據新數據的頻率,計劃每六到十二個月重新訓練您的模型。充分利用 AILLM 只能帶您走這麼遠,並且沒有真正的市場差異化。畢竟,您使用的是與其他人相同的資料 – 從(通常是開源)資料收集的通用資訊。

SLM 是一種更具成本效益的方法,可讓公司在安全的環境中將模型適應其專有資料。更不用說 SLM 對地球更友好,因為它們使用的計算資源明顯更少,並且在能源方面更環保。 SLM 提供的反應能力和適應能力等級是目前生成式 AI 技術無法比擬的。它提供了使用生成式 AI 來改善您的業務的最終途徑。